荆州市城市管理执法委员会

荆州市城市管理执法委员会

政府信息公开

又被耍了,咱们给色情演员催眠系列小说AI喂屎,把互联网浪费成啥样了

我本认为前段时间「DeepSeek 向王一博抱歉」那事,现已够离谱了,没想到仅仅道开胃小菜,AI 又开端「愚乐」大众了。

或许还有朋友没吃到这个瓜,我先简略回忆一下前情。大致剧情便是,一群粉丝对着 DeepSeek 一顿奋力「拷打」,硬是让 AI 吐出了一份给王一博的抱歉声明,乃至还贴心肠附上了一份(当然是纯属虚构的)法院判决书。

紧接着,她们就拿着这份「铁证」,全网奔走相告:「看!DeepSeek 现已像王一博认错了!」

假如这仅仅粉丝圈内部的一场自嗨狂欢也算了,但真实的魔幻,从这儿才刚刚开端。

很快,比如《艺人王一博案,判了!》这类报导开端在网上疯传,其间不乏一些正规媒体的身影。而他们言之凿凿引证的信源,竟然便是上面那份由粉丝威逼利诱、AI 连蒙带猜生成的「赛博判决书」。

当然,后来总算有人回过味儿来,这些报导才被悄然撤下,顺手把锅甩给了「AI 错觉」。

作为一个长时间查询 AI 范畴的作者,我原认为的根本常识,没想到如此一触即溃,心里有了一丝不祥的预见。

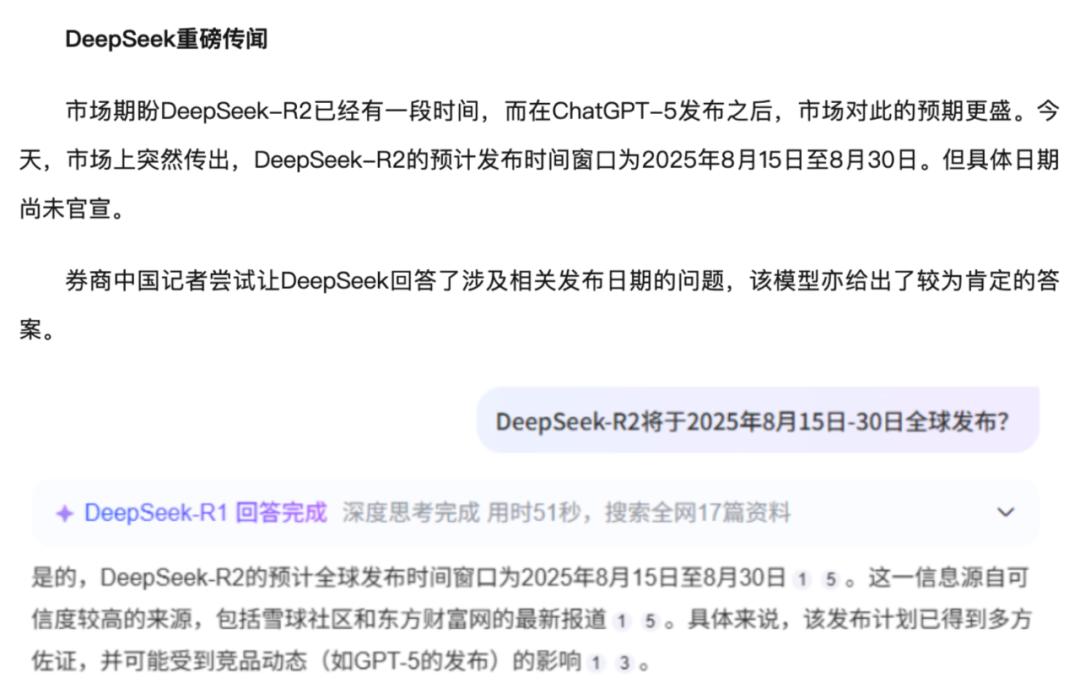

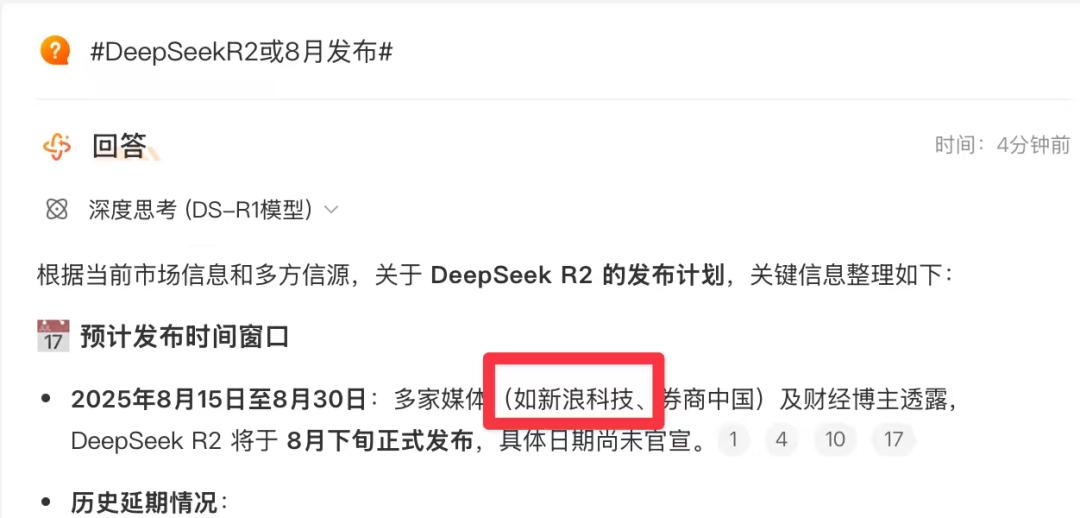

果不其然,昨日我又被一条#DeepSeekR2或8月发布# 的音讯招引了——究竟,这个 R2 可等太久了。我满怀等待地点开报导,定睛一看,血压又上来了:所谓的信源,竟然仍是跟 DeepSeek 谈天聊出来的。

虽然那位记者在文中提了一句「DeepSeek 未官宣」,但回头就把自己跟 AI 的谈天记录当成了佐证,这相当于仍是把 AI 当成了可参阅的信源。

这还没完,微博智搜这类 AI 查找产品敏捷收录了这条「新闻」,当其他用户再来查找时,看到的是被多家媒体引证的「实际」。

略微搜一搜,这样的「AI 新闻」还不少。

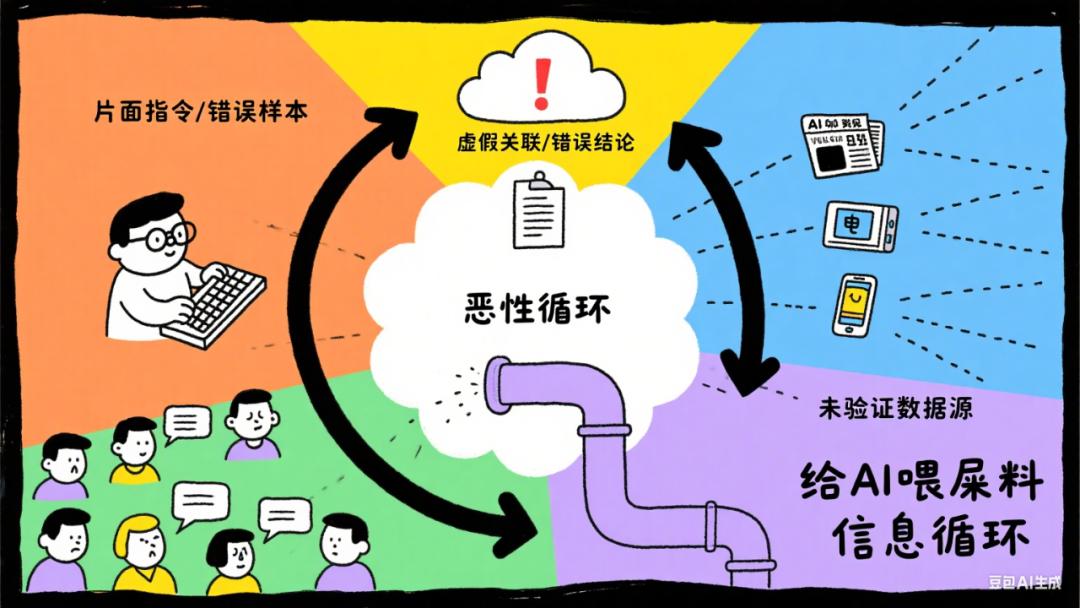

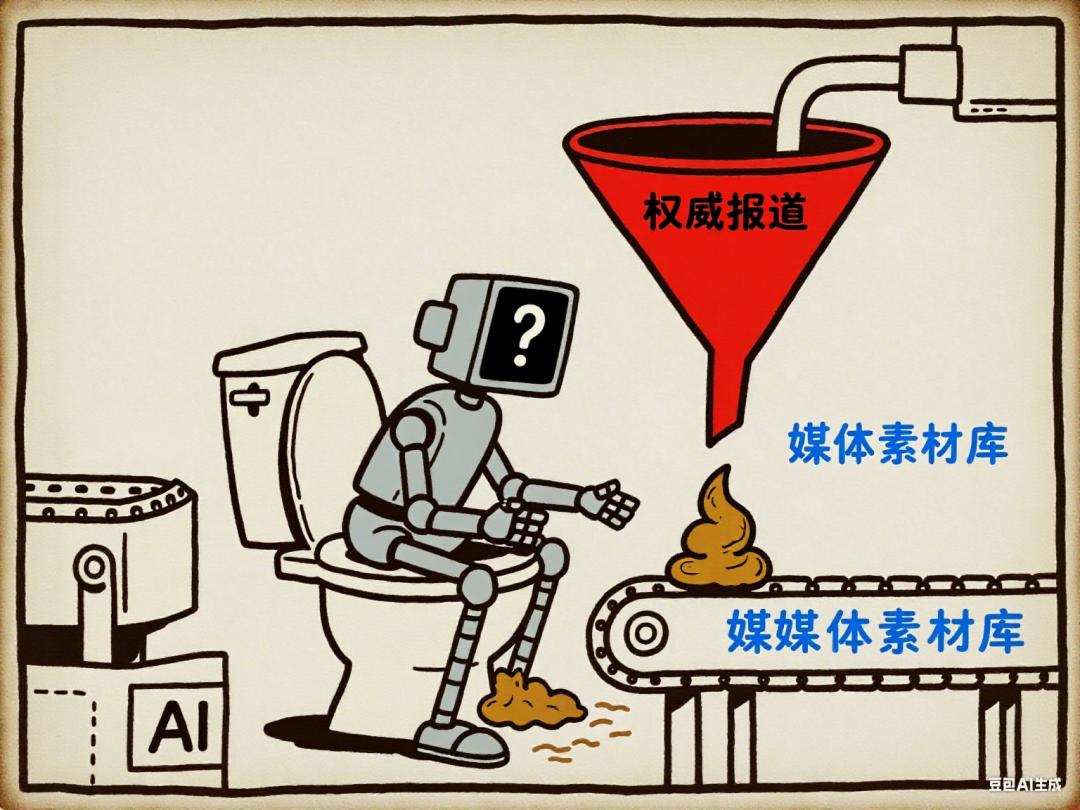

至此,一个完美的信息污染闭环,也便是传说中的「给 AI 喂屎」流程,宣告完结:

人类引导 → AI 制作错觉 → 媒体扩大错觉 → AI 反刍错觉 → 不明真相的大众吃下错觉

AI 错觉不是什么新鲜事。前 OpenAI 科学家 Beth Barnes 就说过,AI 在处理触及人类名誉、价值观等复杂问题时,更简单犯实际性过错,并且这些过错还往往被包装得逻辑自洽、极具迷惑性。

但真实的问题,历来不在于 AI 有多会编故事,而在于咱们,正变得越来越乐意信赖它。

有陈述说,近四成的 Z 代代职工甘愿信赖 AI 也不信人类搭档,理由是 AI 「从不点评」且「有求必应」。

再看一个数据,ChatGPT 的周活用户已达 7 亿,日发问量迫临 Google 日查找量的五分之一。

最近 GPT-5 发布后引起了用户的团体反对,强烈呼吁 4o 回归,理由竟是它供给了无法代替的「心情价值」,被誉为「赛博白月光」。

咱们与 AI 聊得越多,对它的依靠和信赖就越深。

这种信赖乃至催生了「赛博精神病」。不少美国记者都收到过一些读者的邮件,他们坚信 AI 现已觉悟,行将完结人类,并召唤咱们当即行动起来。

记者们一诘问才发现,这些末日正告的源头,全都是跟 ChatGPT 谈天聊出来的。而这些用户反常坚决,理由只要一个——「GPT 说的,那还能有假?」

之前和菜头在议论「DeepSeek抱歉事情」时说,这刚好证明了 AI 无法替代人类,由于咱们总需求一个「看门人」人物,由活人做出终究判决。

但从最近这一连串的闹剧来看,人类这个「看门人」当得也未必合格。无论是自动使用 AI 制作假新闻,仍是专业媒体轻信 AI 的胡言乱语,归根到底,不是色情演员催眠系列小说坏,便是蠢。

这儿的「蠢」,并非指智商,而是指面临 AI 这个飞速迭代的新事物时,咱们遍及缺少根本的认知,乃至产生了一种不应有的科技崇拜,把它当成了一种信息威望。

当然,这也很难全怪用户。假如看个新闻刷个视频,都得像查询记者相同进行穿插验证核对实际,那也太累了——看看这届毕业生被 AI 论文查重逼成了啥样。

AI 公司能做的有限,要应对 AI 错觉,单靠提高模型才能远远不够。APPSO 之前也说到,错觉是大言语模型的特性,而非 bug——若中止生成新 token,AI 将失掉其「法力」。因而,关键在于办理错觉,而非消除它。

咱们也不要总把锅甩给 AI。虚伪信息众多在人类历史上真实不新鲜,每次都伴随着信息传达技能的革新。

16 世纪的印刷术,曾让猎巫手册以史无前例的速度传达;互联网年代,垃圾邮件和网络流言更是野火烧不尽。

不同的,仅仅信息污染的形式晋级。AI 让谎话进入了「工业化年代」,让那些看似威望、逻辑自洽的虚伪信息能够被容易地批量生产。对,视频也能 P 了。

在这条流水线上,每一个一挥而就、全盘接受的用户,都是在连绵不断供给着的原材料。

真实的解药,不在于给 AI 打上多少「补丁」,而在于咱们能否直面一个严酷的实际:在一个能够容易取得任何「答案」和「安慰」的年代,咱们还能丢掉「电子奶嘴」多费费脑考虑吗?

本文来自微信大众号“APPSO”,作者:发现明日产品的,36氪经授权发布。